给大家分享一篇关于 和手机的文章。相信很多朋友对 和手机还是不太了解,所以边肖也在网上搜集了一些关于手机和 的相关知识与大家分享。希望大家看完之后会喜欢。

在上周发表在Arxiv.org预印服务器上的一篇论文中,DeepMind科学家引入了Simple Sensor Intention (SSI)的概念,这是一种用于减少在强化学习中定义奖励(描述AI的功能)所需的知识的方法和系统。他们声称,仅使用原始传感器数据,SSI就可以帮助解决一系列复杂的机器人任务,如抓取、举起球并将其放入杯中。

在机器人领域训练AI通常需要人类专家和先验信息。AI必须根据当前的整体任务进行调整,这需要定义一个表示成功并促进有意义探索的奖励。从表面上看,SSI提供了一种鼓励经销商探索其环境的通用方法,并提供了收集数据以解决重大任务的指南。如果将其商业化或部署在仓库机器人等生产系统中,SSI可以减少对手动微调和计算密集型状态估计(即基于输入和输出测量的系统状态估计)的需求。

正如研究人员所解释的,在没有奖励信号的情况下,人工智能系统可以通过影响机器人传感器(如触摸传感器、关节角度传感器和位置传感器)的学习策略形成探索策略。这些政策探索环境,寻找富有成效的领域,使他们能够收集重大学习任务的质量数据。具体而言,SSI是通过获得传感器响应并根据以下两种方案之一计算奖励来定义的辅助任务集:(1)奖励实现特定目标响应的代理,或(2)奖励经历特定变化的代理。回应。

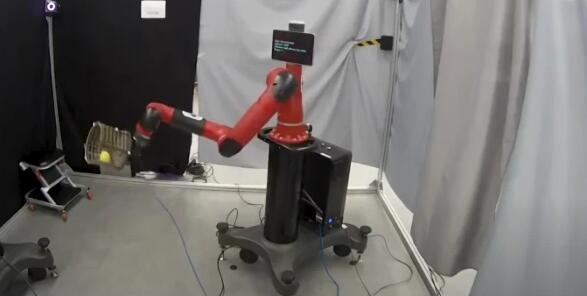

在实验中,本文的合著者将一个装有摄像头的机器人的原始图像(重新思考索耶)转换为少量的SSI。他们总结了图像空间中颜色分布的统计数据,并从场景中物体的颜色估计值中定义了颜色范围和相应的传感器值。他们总共使用了六个基于机器人触摸传感器的SSI,以及两个围绕着装有色块的篮子的摄像头。只有当两个摄像头的颜色分布平均值向所需方向移动时,控制机器人的AI系统才能获得最高的奖励。

研究人员报告称,经过9000次培训(6天),人工智能成功学会了清除障碍。即使在将单一颜色通道的SSI替换为在多个颜色通道上总结奖励的SSI之后,AI也设法从原始传感器信息中提取“各种”不同的对象。在另一个环境下训练了4000集(3天),他学会了玩杯子和球。

在未来的工作中,合著者打算集中精力扩展SSI,以自动生成奖励和奖励组合。他们写道:“我们认为,我们的方法比广泛使用的塑造奖励公式需要更少的先验知识,塑造奖励公式通常取决于任务洞察力的定义和计算的状态估计。”“SSI的定义非常简单,域之间没有或者只有很少的适应性。”

本文就为大家讲解到这里了。标签: